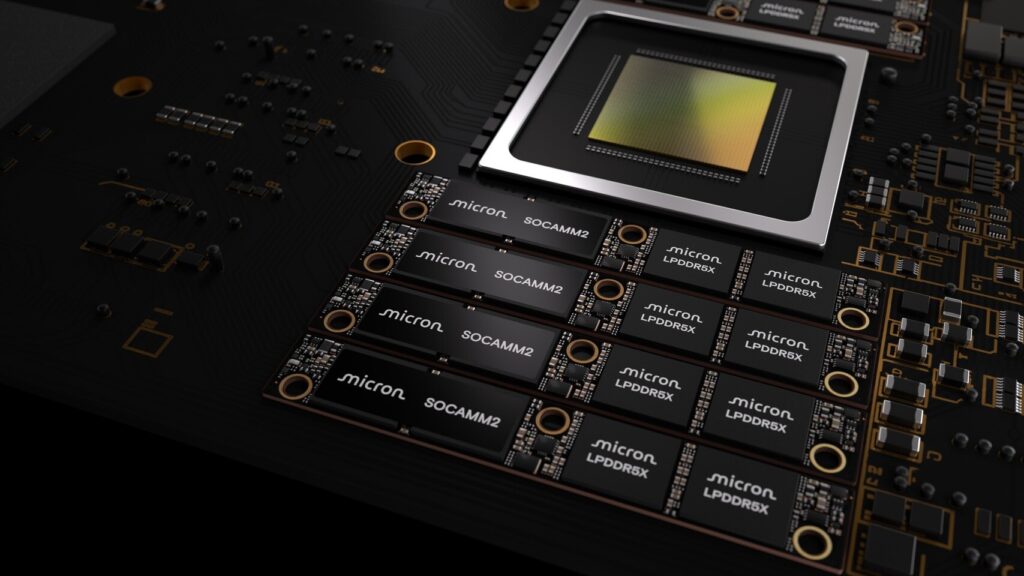

Micron Technology, Inc. annuncia la disponibilità dei primi campioni per clienti del nuovo modulo SOCAMM2 da 256 GB, la soluzione LPDRAM per server a più alta capacità del settore.

La piattaforma è basata sul primo die monolitico LPDDR5X da 32 Gb, un traguardo tecnologico che apre nuove possibilità progettuali per infrastrutture AI e data center di nuova generazione.

L’evoluzione delle applicazioni basate su intelligenza artificiale — tra cui AI training, inferenza, agentic AI e calcolo generale ad alte prestazioni — sta ridefinendo i requisiti dei sistemi server.

Modelli sempre più grandi, finestre di contesto estese e cache persistenti per le chiavi-valore (KV cache) richiedono infatti capacità di memoria più elevate, maggiore efficienza energetica e latenza ridotta.

LPDRAM come elemento chiave per i data center AI

In questo scenario, la memoria LPDRAM si sta affermando come soluzione strategica per server AI e HPC grazie a un equilibrio tra capacità, banda, efficienza energetica e densità fisica.

Per accelerare l’evoluzione delle infrastrutture AI, Micron sta collaborando con NVIDIA allo sviluppo di nuove architetture di memoria destinate ai sistemi di calcolo avanzati.

Il nuovo modulo SOCAMM2 da 256 GB rappresenta un passo significativo verso sistemi server più efficienti e compatti, in grado di gestire carichi di lavoro sempre più complessi senza aumentare il consumo energetico o l’impronta hardware.

Più capacità per server AI e modelli linguistici

Una delle caratteristiche principali del nuovo modulo è l’incremento della capacità rispetto alla generazione precedente.

Il SOCAMM2 da 256 GB offre infatti:

un terzo di capacità in più rispetto ai moduli SOCAMM2 da 192 GB;

fino a 2 TB di LPDRAM per CPU a 8 canali.

Questo livello di memoria permette di gestire modelli AI più grandi, finestre di contesto estese e carichi di inferenza complessi, aspetti sempre più rilevanti per l’elaborazione dei Large Language Models (LLM).

Riduzione dei consumi e maggiore densità nei rack

Un altro vantaggio chiave della soluzione Micron riguarda l’efficienza energetica e la densità hardware.

Il modulo SOCAMM2 da 256 GB:

consuma circa un terzo dell’energia rispetto a moduli server tradizionali come le RDIMM;

occupa solo un terzo dello spazio fisico.

Queste caratteristiche migliorano la densità nei rack dei data center e contribuiscono a ridurre il Total Cost of Ownership (TCO) delle infrastrutture cloud e AI.

Prestazioni migliori per inferenza AI e HPC

Le prestazioni migliorano in modo significativo anche nelle applicazioni di inferenza AI e calcolo ad alte prestazioni.

In architetture di memoria unificata, il nuovo modulo permette:

un time-to-first-token oltre 2,3 volte più rapido nelle inferenze LLM con contesti lunghi;

miglioramenti sensibili nelle operazioni di offload della KV cache.

Nei sistemi basati esclusivamente su CPU, la tecnologia LPDRAM consente inoltre oltre tre volte più prestazioni per watt rispetto ai moduli di memoria server tradizionali utilizzati nelle piattaforme HPC.

Design modulare per scalabilità e manutenzione

Il formato SOCAMM2 introduce anche vantaggi sul piano dell’architettura dei server. Il design modulare consente infatti:

maggiore facilità di manutenzione e sostituzione;

compatibilità con server raffreddati a liquido;

possibilità di espansione futura della capacità di memoria.

Questa modularità è particolarmente importante per infrastrutture AI su larga scala, dove la capacità di aggiornamento progressivo dei sistemi rappresenta un fattore strategico.

Verso nuovi standard di memoria a basso consumo

Micron sta inoltre contribuendo allo sviluppo delle specifiche industriali SOCAMM2 all’interno di JEDEC, l’organismo internazionale che definisce gli standard per le tecnologie di memoria.

Parallelamente, l’azienda mantiene collaborazioni tecniche con produttori di sistemi e progettisti di piattaforme server per accelerare l’adozione della memoria LPDRAM nei data center.

Attualmente Micron offre il portafoglio più ampio di memoria LPDRAM per data center, con componenti da 8 GB a 64 GB e moduli SOCAMM2 che spaziano da 48 GB fino ai nuovi 256 GB.

Con questa evoluzione, l’azienda punta a supportare la prossima generazione di infrastrutture AI, caratterizzate da elevata efficienza energetica, capacità di memoria superiore e architetture server più scalabili.

HW Legend Staff

![Kingston FURY Renegade G5 NVMe M.2 SSD 2TB [SFYR2S/2T0] Cop - Kingston FURY Renegade G5 NVMe M.2 SSD 2TB [SFYR2S2T0]](https://www.hwlegend.tech/wp-content/uploads/2025/10/Cop-Kingston-FURY-Renegade-G5-NVMe-M.2-SSD-2TB-SFYR2S2T0-150x150.webp)