Una nuova startup è emersa oggi dal nulla ed è in grado di alimentare la prossima generazione di intelligenza artificiale generativa. Etched è un’azienda che produce un circuito integrato specifico per l’applicazione (ASIC), in grado di elaborare “Trasformatori”. Il trasformatore è un’architettura per la progettazione di modelli di deep learning sviluppata da Google. Ad oggi tale modello è adottato da GPT-4o di OpenAI in ChatGPT, Antrophy Claude, Google Gemini e la famiglia Llama di Meta.

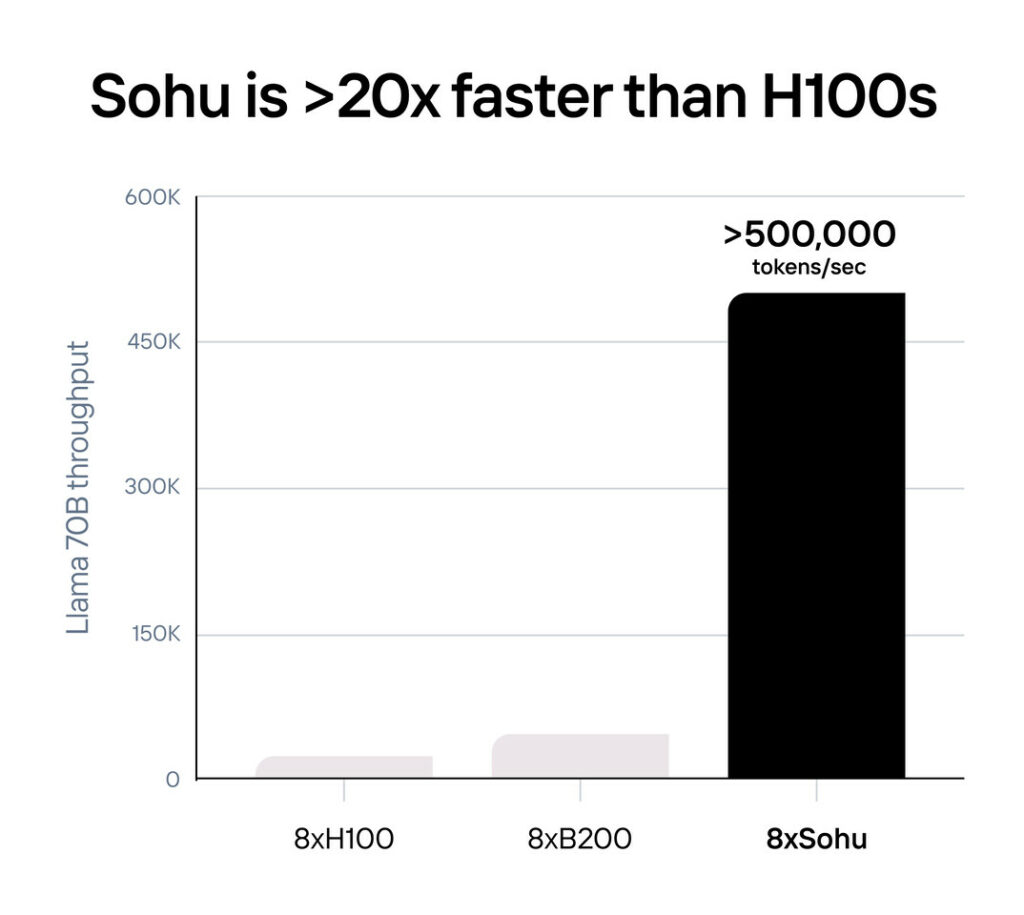

Etched desidera realizzare un ASIC per elaborare solo i modelli del trasformatore, realizzando un chip chiamato Sohu. Tale dispositivo è in grado di superare l’ultimo prodotto di NVIDIA, in quanto una configurazione server con otto cluster GPU NVIDIA H100 spinge i modelli Llama-3 70B a 25.000 token al secondo e gli ultimi otto cluster GPU B200 “Blackwell” spingono 43.000 token/s, gli otto cluster Sohu riescono nell’impresa di produrre 500.000 token al secondo.

Da quanto emerge, ASIC supera Hopper di 20 volte e Blackwell di 10 volte, ed è in grado di garantire così tanti token al secondo da abilitare una flotta completamente nuova di applicazioni AI che richiedono output in tempo reale. L’architettura Sohu è così efficiente che è possibile utilizzare il 90% dei FLOPS, mentre le GPU tradizionali vantano un tasso di utilizzo FLOP del 30-40%. Questo si traduce in inefficienza e spreco di energia, che Etched spera di risolvere costruendo un acceleratore dedicato ai trasformatori di potenza (la “T” in GPT) su larga scala.

Dato che lo sviluppo di tale modello costa più di un miliardo di dollari USA e che i costi dell’hardware sono misurati in decine di miliardi di dollari USA, avere un acceleratore dedicato al potenziamento di un’applicazione specifica può aiutare a far avanzare l’intelligenza artificiale più rapidamente. I ricercatori di intelligenza artificiale spesso affermano che “la scala è tutto ciò di cui hai bisogno” (simile al leggendario documento “l’attenzione è tutto ciò di cui hai bisogno”), e Etched vuole basarsi su questo.

Ci sono però alcuni dubbi per il futuro. Sebbene si creda generalmente che i trasformatori siano il “futuro” dello sviluppo dell’intelligenza artificiale, avere un ASIC risolve il problema finché le operazioni non cambiano. Ad esempio, questo ricorda la mania del mining di criptovalute, che ha portato alcuni cicli di minatori ASIC di criptovaluta che ora sono pezzi senza valore, come i minatori di Ethereum erano soliti estrarre la moneta ETH sulla prova del work staking, e ora gli ASIC di mining ETH sono inutili.

Ciononostante, Etched vuole che la formula del successo sia semplice: eseguire modelli basati su trasformatori ASIC Sohu con un ecosistema software open source e scalarli fino a raggiungere dimensioni enormi. Anche se i dettagli sono scarsi, sappiamo che l’ASIC funziona con 144 GB di memoria HBM3E e che il chip è prodotto con il processo a 4 nm di TSMC. Abilitare modelli di intelligenza artificiale con 100 trilioni di parametri significherebbe disporre di un prodotto in grado di essere ben 8 volte più grande del progetto da 1,8 trilioni di parametri, presenti su GPT-4.

HW Legend Staff

![Kingston FURY Renegade G5 NVMe M.2 SSD 2TB [SFYR2S/2T0] Cop - Kingston FURY Renegade G5 NVMe M.2 SSD 2TB [SFYR2S2T0]](https://www.hwlegend.tech/wp-content/uploads/2025/10/Cop-Kingston-FURY-Renegade-G5-NVMe-M.2-SSD-2TB-SFYR2S2T0-150x150.webp)