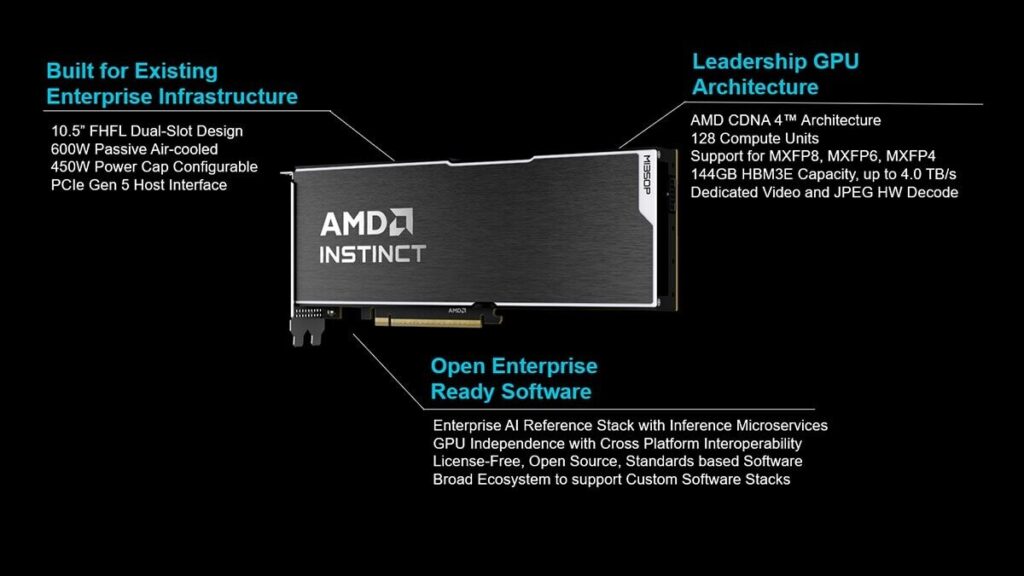

AMD ha annunciato le nuove acceleratrici Instinct MI350P PCIe, schede GPU pensate per portare prestazioni AI di fascia enterprise all’interno dei data center esistenti, senza richiedere costosi interventi su alimentazione, raffreddamento o infrastruttura rack.

Le nuove soluzioni puntano a offrire un’alternativa concreta tra cloud AI e piattaforme GPU dedicate ad alto assorbimento energetico, semplificando l’adozione dell’intelligenza artificiale on-premise.

AI enterprise in formato PCIe standard

Le AMD Instinct MI350P sono schede PCIe dual-slot progettate per server standard raffreddati ad aria. L’obiettivo è permettere alle aziende di implementare workload AI direttamente nelle infrastrutture già presenti nei data center.

AMD evidenzia come molte imprese incontrino difficoltà nell’espansione delle capacità AI a causa di:

- costi elevati del cloud;

- problematiche di privacy e compliance;

- necessità di aggiornamenti infrastrutturali complessi;

- consumi energetici elevati delle piattaforme GPU tradizionali.

Le nuove MI350P vogliono quindi offrire elevate prestazioni AI mantenendo compatibilità con ambienti enterprise convenzionali.

Prestazioni AI fino a 4.600 TFLOPS

Dal punto di vista tecnico, AMD dichiara per le nuove Instinct MI350P prestazioni fino a:

- 2.299 TFLOPS stimati;

- picchi fino a 4.600 TFLOPS in precisione MXFP4.

Secondo l’azienda, si tratta attualmente delle prestazioni più elevate disponibili per una scheda PCIe enterprise.

Le GPU integrano inoltre:

- 144 GB di memoria HBM3E;

- bandwidth fino a 4 TB/s;

- supporto a formati FP8, MXFP8, MXFP6 e MXFP4;

- accelerazione tramite sparsity per INT8 e BF16.

AMD punta in particolare sulle precisioni ridotte per aumentare throughput ed efficienza energetica nei workload AI moderni, inclusi inference e pipeline RAG.

Pensate per inferenza AI e modelli generativi

Le nuove schede sono progettate soprattutto per:

- inferenza AI on-premise;

- modelli linguistici di piccole, medie e grandi dimensioni;

- sistemi RAG (Retrieval-Augmented Generation);

- workload enterprise basati su AI agentica.

AMD prevede configurazioni fino a otto acceleratori per server, mantenendo il raffreddamento ad aria tradizionale.

Ecosistema open source e compatibilità software

Uno dei punti chiave della strategia AMD è il supporto a un ecosistema AI aperto e interoperabile.

Le Instinct MI350P supportano:

- PyTorch;

- Kubernetes GPU Operator;

- AMD Inference Microservices;

- stack AI enterprise open-source AMD.

Secondo l’azienda, questo approccio permette di migrare workload AI con modifiche minime al codice, riducendo tempi di implementazione e costi operativi.

AMD fornirà inoltre il proprio enterprise AI reference stack senza costi di licenza ai partner hardware e software.

AI enterprise senza riprogettare il data center

Con le Instinct MI350P PCIe, AMD punta chiaramente alle aziende che vogliono adottare l’intelligenza artificiale senza affrontare la complessità delle infrastrutture GPU hyperscale.

L’azienda sottolinea che le nuove GPU consentono di:

- aumentare il numero di modelli AI gestibili;

- servire più utenti contemporaneamente;

- ridurre consumi e raffreddamento;

- evitare costose modifiche infrastrutturali.

Una proposta che potrebbe risultare particolarmente interessante per aziende enterprise, provider privati e infrastrutture edge AI.

HW Legend Staff