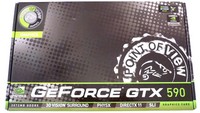

Dopo l’uscita della HD6990 da parte di AMD, recensita qui, anche Nvidia entra in campo con la sua soluzione ammiraglia a doppia gpu, la GTX 590, per contendersi l’ambito titolo di “World’s Fastest Grafics Card” oltre a completare la line up della famiglia Fermi. In questa recensione andremo ad analizzare il modello brandizzato Point of View, che a parte il marchio è identico in tutto e per tutto alla reference di Nvidia. Ovviamente il prodotto in questione, come la controparte di AMD, è indicato al pubblico degli Enthusiast o comunque a tutti quegli utenti che non vogliono compromessi in termini di prestazioni, sacrificando sia i consumi che il calore generato. Scopriamo insieme le potenzialità di questo “mostro”, sperando che la lettura sia piacevole e di vostro gradimento. Non ci resta che augurarvi una piacevole lettura del nostro articolo!

Dopo l’uscita della HD6990 da parte di AMD, recensita qui, anche Nvidia entra in campo con la sua soluzione ammiraglia a doppia gpu, la GTX 590, per contendersi l’ambito titolo di “World’s Fastest Grafics Card” oltre a completare la line up della famiglia Fermi. In questa recensione andremo ad analizzare il modello brandizzato Point of View, che a parte il marchio è identico in tutto e per tutto alla reference di Nvidia. Ovviamente il prodotto in questione, come la controparte di AMD, è indicato al pubblico degli Enthusiast o comunque a tutti quegli utenti che non vogliono compromessi in termini di prestazioni, sacrificando sia i consumi che il calore generato. Scopriamo insieme le potenzialità di questo “mostro”, sperando che la lettura sia piacevole e di vostro gradimento. Non ci resta che augurarvi una piacevole lettura del nostro articolo!

Introduzione:

Nvidia Corporation è una grande azienda produttrice di processori grafici, schede madrii e in generale prodotti multimediali per PC e console come la prima Xbox e la nuova Playstation 3. Il suo quartiere generale è a Santa Clara in California. Il nome dell’azienda è stato scelto perché ricorda le parole “video” e “invidia” in particolare, si pronuncia come lo spagnolo “envidia“.

Per maggiori informazioni andate sul sito di Nvidia.

Point of View, nota per la sua gamma di schede grafiche basate su GPU NVIDIA, è stata fondata nel 2000. da quella data le vendite di schede Point of View sono aumentate in modo esponenziale e ora il marchio è presente in oltre 70 paesi del mondo. La sede centrale di Point of View è nei Paesi Bassi. Da qui il team di vendita poliglotta dell’azienda gestisce l’intero mercato europeo. Tuttavia, l’azienda ha anche altre sedi: Point of View Iberia (in Spagna), Point of View Asia (a Taiwan), Point of View Brazil e Point of View USA.

Per maggiori informazioni andate sul sito Point Of View.

Prima di andare ad analizzare il nuovo prodotto Nvidia, è doveroso soffermarci velocemente sulla nuova architettura del GF110.

{jospagebreak_scroll title=Nvidia GTX 590:Architettura del GF110&heading=Introduzione:}

Nvidia GTX 590: Architettura del GF110

Con l’introduzione nel mercato della GTX 580, Nvidia lancia finalmente sul mercato la vga pensata inizialmente come rivale della HD5870, che purtroppo per via di diversi problemi divenne la GTX 480 che tutti oggi conosciamo. Il cuore pulsante di questa nuova vga è il GF110, una versione corretta e riveduta dell ‘iniziale GF100 che veniva utilizzato sulla famiglia GTX 480/470. Rispetto al suo predecessore, questo chip grafico oltre ad avere tutte le unità funzionali operative, ha un incremento della frequenza operativa con però minor consumo energetico, dovuto da un affinamento dell’architettura interna oltre alla rimozione della parte del GPGPU di cui era dotato il GF100, infatti ci sono 200 milioni di transistor in meno (GF100 3,2mil vs GF110 3mil).

Siccome il GF110 non è altro la naturale evoluzione del GF100 (si potrebbe benissimo chiamare GF100b), l’architettura interna è molto simile, infatti troviamo sempre quattro Graphics Processing Cluster (GPC), ognuno con quattro Streaming Multiprocessor (SM) equipaggiati di 32 CUDA Core ciascuno, suddivisi a gruppi di quattro. Rispetto al GF100, tutte le 16 unità SM sono state attivate, in modo da avere a disposizione, complessivamente, ben 512 CUDA Core.

L’architettura alla base di questo nuovo processore grafico presenta moltissime analogie con quella del predecessore GF100. Troviamo sempre quattro Graphics Processing Cluster (GPC), ognuno con quattro Streaming Multiprocessor (SM) equipaggiati di 32 CUDA Core ciascuno, suddivisi a gruppi di quattro. Rispetto a GF100, tutte le 16 unità SM sono state attivate, in modo da avere a disposizione, complessivamente, ben 512 CUDA Core.

Ciascuna unità SM è affiancata da quattro Texture Unit, un Polymorph Engine, sedici unitàLoad/Store, quattro unità speciali SFU (in grado di eseguire istruzioni come seno, coseno e radice quadrata, oltre che l’interpolazione grafica) e una cache dedicata da 64KB utilizzabile come memoria condivisa o come cache L1.

Ogni singolo CUDA Core integra al proprio interno una Dispatch Port, seguita da un’unità per la raccolta degli operandi durante le fasi di calcolo (Operand Collector), due unità distinte per le operazioni sugli interi e in virgola mobile (FP Unit e INT Unit) connesse a una Result Queue in cui vengono raccolti i risultati delle operazioni delle due unità di calcolo.

Le elaborazioni interne a ognuno di questi core sono eseguite con precisione IEEE-754 2008 per le operazioni in virgola mobile e a 32bit per quelle con interi: la risultante sono unità di elaborazione indipendenti per le due tipologie pienamente compatibili con gli standard di mercato, caratteristica particolarmente utile non tanto in ambito ludico quanto in quello professionale GPU Computing.

Il PolyMorph Engine è responsabile delle operazioni di Vertex Fetch, Tessellation, Viewport Transform, Attribute Setup, e Stream Output.

Il back-end è sempre composto di 6 partizioni ROPs, ognuna in grado di gestire 8 integer pixel a 32 bit alla volta, raggiungendo quindi 48 pixel per clock. Il bus di memoria è di tipo aggregato e sfrutta sei interfacce a 64 bit al fine di raggiungere un’ampiezza complessiva di 384 bit, così come in GF100. Inoltre, il nuovo processore grafico, è in grado di eseguire il Texture Filtering FP16 in un solo ciclo di clock, in maniera analoga a quando visto in GF104, contro i due cicli necessari al predecessore. Questo si traduce sostanzialmente in maggiori prestazioni in tutte quelle applicazioni, ad esempio, in cui GF100 era “texturing-limited”. Un’altra miglioria interessa l’efficienza delle operazioni Z-culling, atte a massimizzare la banda di memoria disponibile.

Secondo NVIDIA, l’insieme di queste migliorie, permette di incrementare le performance complessive di circa 5-14% in relazione al titolo/benchmark in uso, rispetto a GF100.

Allo stato attuale sono tre le soluzioni di NVIDIA basate sul nuovo GF110:

- GeForce GTX 590 “Dual GPU”;

- GeForce GTX 580;

- GeForce GTX 570.

Nella tabella che segue, ne riassumiamo brevemente le principali caratteristiche tecniche:

Come possiamo vedere, la GeForce GTX 590 non è altro che l’unione di due GF110 completi su un unico pcb, con 3072Mb GDDR5 di Vram (1536Mb x 2) e 768 bit di bus (384 bit x 2). In sostanza la nuova nata di casa Nvidia non è altro che l’unione sulla singola scheda di due GeForce GTX 580, ovviamente con frequenze ridotte per contenere sia l’assorbimento, sia il calore che il rumore entro limiti “ragionevoli”. Subito sotto troviamo la GeForce GTX 580, attualmente la vga single gpu più veloce sul mercato, dotata delle stesse caratteristiche della sorella GTX 590 ma con l’unica differenza di avere frequenze più spinte sia sulla Vram che sulla GPU. Infine, l’ultima vga ad adottare il GF110 come GPU è la GeForce GTX 570, dotata di 480 cuda core attivi, 1280Mb GDDR5 di Vram e 320 bit di bus, oltre ad avere frequenze di funzionamento più contenute rispetto alla GeForce GTX 580.

Dopo questa breve introduzione sul nuovo GF110 di casa Nvidia, ora passiamo all’analisi vera e propria della GeForce GTX 590.

{jospagebreak_scroll title=Point Of View GeForce GTX 590: Features – Parte Prima}

Point Of View GeForce GTX 590: Features – Parte Prima

La Point Of View GeForce GTX 590 è una scheda grafica molto completa. Le features sono molto interessanti e permettono di sfruttare la scheda video in diversi ambiti e applicativi. Riassumiamo le features più interessanti:

- DirectX 11 Support;

- NVIDIA GeForce CUDA Support;

- NVIDIA 3D Vision Surround

- NVIDIA PhysX;

- PCI Express 2.0;

- PureVideo HD.

DirectX 11:

Nvidia con il chip GF110 ha migliorato l’architettura grafica, sconvolgendo in parte o potenziando le sue precedenti soluzioni grafiche. La GTX590 è studiata per supportare le nuove API DirectX 11.

I tre elementi “cardine” delle directX11 sono:

- Tessellation: Direttamente implementata nella GPU per calcolare superfici curve in modo più armonioso, consentendo quindi di ottenere immagini graficamente più dettagliate.

- Multi-Threading: Maggior supporto e scalabilità per le CPU multi-core.

- DirectCompute: La possibilità di usare schede video discrete per accelerare videogiochi e applicativi d’uso comune.

Il funzionamento dell’unita di Tessellation non è complicata e permette di partire da un modello 3D poco complesso, per arrivare ad uno molto complesso senza appesantire troppo la GPU. Un tessellatore prende un poligono e lo suddivide in molti triangoli per amplificare il dettaglio dell’oggetto, applicando ricorsivamente una regola di suddivisione. Con la tecnologia tessellation si potranno introdurre nei giochi dei personaggi ultra dettagliati e renderizzati in tempo reale che ricorderanno molto quelli dei film di animazione. Tutto è gestito via hardware. I benefici di questa tecnologia paiono evidenti, più poligoni significano maggiori dettagli e perciò maggiore realismo.

Questa tecnica consente di aumentare in maniera esponenziale il numero di triangoli per la sua riproduzione, con un livello di dettaglio che è variabile a seconda del punto di osservazione “più questo è vicino, maggiori saranno i triangoli generati così da incrementare il realismo dell’oggetto”. Le DirectX 11 introducono anche lo Shader Model 5.0 offrendo cosi agli sviluppatori un approccio di programmazione ben indirizzato. Questa è l’ultima evoluzione dello shader model, dopo quello 4.0 implementato con le API DirectX 10 e lo shader model 3.0 delle prime architetture DirectX 9.0c. Interessante è la Gestione Multi-threading: Le directX 11 gestiscono in modo più efficiente rispetto alle precedenti i processi multithreading.

Le applicazioni, DirectX runtime e DirectX driver possono ora essere eseguiti in threads separati. Altre operazioni come il caricamento di una texture ,possono avvenire in parallelo con il principale task di rendering della scena. Questa nuova implementazione nelle API, permetterà agli sviluppatori, di “ottimizzare” al meglio le cpu Multi-threading, dosando in maniera omogenea il carico di lavoro. In questa maniera si potranno ottenere prestazioni decisamente più elevate con le cpu multi-core.

Le directX 11 implementano la possibilità di usare schede video discrete per accelerare videogiochi e applicativi d’uso comune. Questa nuova funzione, prende il nome di DirectCompute. Queste aplicazioni includono la fisica, il ray-tracing, l’intelligenza artificiale, il post processing dell’immagine, la trasparenza order-independent, il rendering delle ombre e la transcodifica video con la tecnologia CUDA.

NVIDIA GeForce CUDA Support:

CUDA è un’architettura di elaborazione in parallelo realizzata da NVIDIA che permette netti aumenti delle prestazioni di computing grazie allo sfruttamento della potenza di calcolo delle GPU “unità di elaborazione grafica”. La tecnologia NVIDIA CUDA è il solo ambiente in linguaggio “C” che permette ai programmatori e agli sviluppatori di programmare applicazioni software in grado di risolvere i problemi di calcolo più impegnativi riducendo nettamente il tempo necessario grazie alla potenza di elaborazione in parallelo multi-core delle GPU. I prodotti compatibili con NVIDIA CUDA possono aiutare ad accelerare le operazioni più impegnative, per esempio, codifica audio e video, prospezione petrolchimica, progettazione di prodotti, imaging medico e ricerca scientifica, solo per citare le più eclatanti.

Molti programmi CUDA richiedono almeno 256 MB di memoria residenti sulla GPU.Sono stati rilasciati applicativi commerciali che supporteranno questa tecnologia, primi fra tutti Adobe Photoshop CS4 e Badaboom Media Converter ecc.…Ricordiamo che già attualmente la tecnologia CUDA riesce ad accelerare programmi come GPUGRID. Il team del progetto PS3GRID ha annunciato il supporto per le GPU Nvidia con BOINC. Nasce così GPUGRID, il primo progetto BOINC per GPU. GPUGRID si propone di creare una potente infrastruttura per le simulazioni biomolecolari sfruttando oltre alla potenza delle PS3, anche la potenza delle GPU.

Il settore del HIGH Performance Computing, è continua espansione e NVIDIA vuole entrare in questo mercato. Molto interessante è l’evoluzione della nuova tecnologia CUDA, che promette di snellire, attraverso soluzioni ben ottimizzate per la scheda, il carico di lavoro della CPU grazie all’uso più massiccio della GPU. Un primo esempio di CUDA è arrivato in questi giorni anche nel settore videoludico. Il gioco Just Cause 2 sfrutta la tecnologia CUDA per rendere più realistico l’effetto acqua.

Con la tecnologia CUDA abbiamo:

- ElementLinguaggio C standard per lo sviluppo di applicazioni in parallelo sulle GPU;

- Librerie numeriche standard per FFT e BLAS;

- Driver CUDA dedicato per l’elaborazione con percorso dati velocizzato tra GPU e CPU;

- Driver CUDA interoperabili con i driver grafici OpenGL e DirectX;

- Supporto per i sistemi operativi Linux a 32/64 bit e Windows 7 32/64 bit.

NVIDIA 3D Vision Surround:

La tecnologia 3D Vision Surround di Nvidia ci permette di utilizzabili ben 3 schermi in configurazione surround, ciascuno dei tre avrà la visibilità in 3D, per utilizzare questa tecnologia servirà utilizzare due schede video della serie GeForce GF110 collegate entrambe con la tecnologia SLI. Le due schede lavorano in modalità AFR (alternate frame rendering). Questa tecnica è quella ad oggi più utilizzata e prevede la gestione di ogni singolo frame su una GPU per volta, in modo alternato.

Le due GPU presenti in configurazione SLI si fanno carico in maniera alternata della gestione dei frame, dividendosi il lavoro. Nella modalità Surround il rendering viene gestito in modalità AFR: in questo scenario il carico di lavoro aumenta in maniera consistente, visto che ogni frame viene calcolato due volte da ogni GPU una per ogni occhio. I due dati elaborati vengono successivamente uniti attraverso il bridge SLI e visualizzati a schermo.

Per poter giocare in modalità stereoscopica su tre schermi contemporaneamente è necessaria una potenza di calcolo ragguardevole, impossibile da erogare con una sola scheda video. Oltre ai driver per questa tecnologia Nvidia fonisce una lista di videogiochi che supportano la tecnologia 3D Vision Surround ed un documento in cui mostra come utilizzare al meglio questa nuova tecnologia. Nvidia dà la possibilità di abilitare la modalità stereoscopica su tre monitor, a patto di possedere tre monitor da 120 Hz identici, due schede grafiche in modalità SLI e il kit GeForce 3D Vision. A differenza della tecnologia multi-monitor di ATI, inoltre, 3D Vision Surround non necessita di monitor DisplayPort: è sufficiente avere 3 normali display LCD con porta DVI dual-link.

{jospagebreak_scroll title=Point Of View GeForce GTX 590: Features – Parte Seconda}

Point Of View GeForce GTX 590: Features – Parte Seconda

NVIDIA PhysX:

Dopo la recente acquisizione di Ageia da parte di NVIDIA, la casa californiana, ha deciso di integrare attraverso la tecnologia CUDA, tutte le funzionalità delle PPU “unità di elaborazione della fisica” all’interno della stessa scheda video. La tecnologia PhysX offre un incremento nella potenza di elaborazione della fisica virtuale e porta i giochi ad ottenere un maggior realismo grazie alla possibilità di creare ambienti ricchi e coinvolgenti, dotato di funzionalità quali:

- Esplosioni che provocano la comparsa di nubi di polvere e detriti;

- Personaggi con geometrie complesse e dotate di giunture per rendere più verosimili; movimenti e interazioni;

- Nuove e spettacolari armi dotate di effetti speciali davvero straordinari;

- Tessuti che si tendono e si strappano in modo naturale;

- Fumo e nebbia densi che creano volute attorno agli oggetti in movimento.

- PhysX è un potente motore di fisica di gioco che permette di integrare effetti fisici in tempo reale nei più innovativi giochi per PC e console.

PCI Express 2.0:

Il nuovo supporto al PCI Express 2.0 si mantiene compatibile con la versione 1.0, porta con sé diverse novità, la più importante delle quali è data dal raddoppio della frequenza operativa, e di conseguenza della banda passante per singola via: dai 2,5 gigatranfers al secondo (GT/s) dell’attuale bus si è passati a 5 GT/s. La velocità di un link in modalità x16 è ora all’incirca di 16 Gbyte/s. La maggiore velocità del bus sarà importante sia per supportare l’evoluzione delle altre interfacce di comunicazione dei PC, come SATA e SAS, sia per sostenere il traffico generato dai controller di rete multi porta e dalla nuova generazione di schede grafiche DirectX 10, specie se in configurazione dual-Gpu.

Il PCI-express 2.0 è in grado di erogare fino a 300 watt di potenza, più che sufficiente a sostenere il fabbisogno energetico delle schede grafiche più performanti. PCI-express 2.0 introduce diverse nuove funzionalità a livello di protocollo che, secondo quando spiegato da PCI-SIG, “permettono agli sviluppatori di progettare dispositivi più intelligenti e capaci di ottimizzare le performance della piattaforma e ottimizzare i consumi energetici. Il PCI Express 2.0 offrie slot x1, x4, 8x e 16x e la frequenza è di 250 MHz.

PCI-ex 2.0 permette poi una più avanzata gestione delle periferiche, degli slot, delle interconnessioni, dei trasferimenti peer-to-peer, dei timeout, dei dispositivi multifunzione, degli accessi e del routing dei pacchetti. Si segnala infine la funzione Input-Output Virtualization (IOV), progettata per semplificare la condivisione delle periferiche PCI-ex fra più macchine virtuali.

PureVideo HD:

Tale tecnologia viene utilizzata dal core di elaborazione video della GPU NVIDIA e dagli applicativi software appositamente sviluppati. Questa sinergia è in grado di fornire una qualità video davvero eccellente con un utilizzo minimo della CPU e un basso consumo energetico. La tecnologia PureVideo permette una qualità dell’immagine perfetta, una riproduzione senza rallentamenti e la massima libertà di connessione. I formati supportati per l’accelerazione hardware sono molteplici, H.264, WMV/VC-1 e MPEG-2 HD ed SD con utilizzo minimo della CPU.

La tecnologia PureVideo HD sfrutta la GPU per l’elaborazione video, liberando la CPU di eseguire altre applicazioni durante la riproduzione di un filmato ad alta definizione.

Riportiamo di seguito le caratteristiche della tecnologia NVIDIA PureVideo HD:

Video massima fluidità:

- Core di elaborazione video dedicato offre al PC video ad alta definizione di fluidità sensazionale senza saltellamenti o interruzioni;

- L’elaboratore video programmabile accelera i filmati in formato H.264, WMV/VC-1, and e MPEG-4 ad alta definizione;

- Il core di elaborazione video discreto assorbe le complesse operazioni video, alleggerendo il carico di lavoro di CPU e motore 3D. Grazie a questa soluzione il PC è in grado di eseguire più applicazioni simultaneamente, pur assorbendo una quantità minore di energia.

Nitidezza e brillantezza dell’immagine:

- Immagini della massima nitidezza ed elimina completamente sdoppiamenti, sfocature e distorsioni;

- I bordi frastagliati vengono sfumati grazie all’ interlacciamento spazio-temporale e a tecniche di ridimensione all’avanguardia.

Colori precisi e vivaci su qualsiasi display:

- Gamma, luminosità, saturazione, correzione della temperatura del colore offrendo immagini verosimili e colori vivaci su tutti i display;

- Il supporto nativo dei dispositivi HDTV permette di gestire televisori ad alta definizione con risoluzione di 1920x1080p grazie a interfacce Componente, DVI e HDMI.

{jospagebreak_scroll title=Confezione e Bundle:}

Confezione e Bundle:

La scheda è giunta in redazione all’interno della confezione originale prevista dal produttore. Esteticamente gradevole alla vista, è anche molto robusta, al punto che riteniamo improbabile che si possano verificare danneggiamenti del prodotto durante il trasporto.

Nella parte frontale spicca la dicitura “GeForce GTX 590”, che fa già presagiere a potenza della vga in questione, inoltre troviamo il grande marchio a forma di camaleonte del noto brand Point Of View (e nemmeno a farlo apposta di Nvidia stessa). Partendo dall’angolo sinistro della confezione troviamo i punti salienti di questa vga, ovvero 3072Mb di Vram (ricordiamo che sono sempre il totale della memoria messa a disposizione dei due GF110, ovvero “1576Mb x 2”), supporto nativo al 3D Surround Vision (infatti visto che è una soluzione a doppia gpu è capace di gestire più anche tre monitor in contemporanea in 3D), Physx, DirectX11 e se non bastasse anche il supporto allo SLi.

Sul retro della confezione invece non troviamo nessuna informazione degna di nota, se non il sito internet del produttore ed un piccola introduzione alle features offerte delle nuova linea di vga di casa Nvidia. Aprendo la confezione ci troviamo ad un imballaggio alquanto strano, ovvero la vga è chiusa si in una busta antistatica, ma è anche vero che non c’è nessun’altro tipo di protezione all’interno della scatola, tant’è che il bundle all’interno durante il trasporto o il semplice spostamento, può sbattere contro la vga e questo non è assolutamente accettabile visto il prezzo di vendita del prodotto.

Questo è il messaggio di avvertimento che troveremo sulla busta antistatica che avvolge la vga. Possiamo leggere con estrema facilità il corretto montaggio dei cavetti di alimentazione (in questo caso ci servono due connetti da 8pin). Nvidia raccomanda estrema attenzione nel rimuovere la scheda video dopo lo spegnimento del pc, poiché potrebbe essere “rovente”.

Il bundle contenuto nella confezione è estremamente basilare e nello specifico troviamo:

- 1x CD-Rom Driver;

- 1x Adattatore DVI to VGA;

- Manuale d’istruzioni.

Ora siamo pronti per andare ad analizzre in dettaglio la soluzione Point Of View GeForce GTX 590.

{jospagebreak_scroll title=Layout e Specifiche Tecniche – Parte Prima:}

Layout e Specifiche Tecniche – Parte Prima:

La Point Of View GeForce GTX 590 al primo sguardo appare imponente ed elegante allo stesso tempo. Il design sia del pcb che del sistema di dissipazione e quello reference prodotto da Nvidia, infatti troviamo la grande ventola assiale centrale da 8cm, e anche se non visibili per via della copertura in plastica, i due vapor chamber che hanno il compito di raffreddare i “bollenti spiriti” dei due GF110.

La GeForce GTX 590 è lunga 28 cm, 2,4cm in meno della AMD Radeon HD 6990. Nel retro della vga possiamo notare due grandi placche in plastica che servono non tanto per il raffreddamento dei moduli di Vram in sé, quanto per protezione in caso di urti accidentali degli stessi. Inoltre, in alto a destra, è possibile notare il connettore SLi per abilitare la modalità “Quad SLi”. Una delle prime cose che saltano all’occhio guardando la GeForce GTX 590 è sia la forma della cover in plastica superiore sia l’ingombro del sistema di dissipazione. Anche occupando due slot ed avendo due “caldi” GF110 al proprio interno, il sistema di dissipazione è in grado di svolgere agevolmente il suo compito, in quanto nulla è lasciato al caso, infatti basta dare uno sguardo più attendo alla cover ed alla ventola per capire quanto impegno abbia profuso Nvidia nella realizzazione di questa soluzione grafica.

Entrando nel dettaglio è possibile vedere che la cover superiore si svasa verso il basso proprio in corrispondenza della ventola centrale, lasciando proprio quest’ultima leggermente sollevata. Soluzione a nostro avviso molto interessante, in quanto oltre a raffreddare la cover in sé nella parte superiore serve soprattutto in caso di SLi o comunque in quei casi in cui ci sia un’altra periferica davanti la nostra vga, infatti in questo modo la ventola rimane sempre libera ed ha lo spazio necessario per attingere aria dal case. Interessante notare come le pale della ventola siano sfalsate rispetto al piano della cover.

La parte frontale della scheda ha 3 porte DVI ed una mini HDMI, per la gestione anche di 3 monitor a 120Hz contemporaneamente (3D Vision Surround). Infine possiamo notare i due connettori ad 8pin che servono ad alimentare la scheda. Nvidia raccomanda un alimentatore da almeno 700W con almeno 50A su i +1.

Quando la scheda video è in funzione è possibile ammirare il logo luminoso GeForce, che oltre a dare un tocco di eleganza alla vga, indica eventuali malfunzionamenti della stessa, attraverso vari tipi di lampeggio.

La serie Point Of View GeForce GTX 590 rappresenta una soluzione reference design. Nella seguente tabella, riassumiamo le principali basata sulla medesima GPU:

Specifiche Tecniche:

Il software GPU-Z 0.5.3 rileva correttamente tutte queste specifiche:

{jospagebreak_scroll title=Layout e Specifiche Tecniche – Parte Seconda:}

Layout e Specifiche Tecniche – Parte Seconda:

Rimuovendo il dissipatore di calore possiamo osservare la scheda in tutta la sua interezza. I componenti sono posti ordinatamente sulla superficie del PCB. Nelle due estremità del PCB è possibile notare i due processori grafici NVIDIA GF110, circondati dai moduli di memoria, disposti a ferro di cavallo attorno ad esso. Gran parte del restante spazio è occupato dalla circuiteria di alimentazione. Le componenti impiegate sono di ottima qualità e adatte a reggere in condizioni di stress e overclock.

La scheda è composta da due GPU Nvidia GF110 caratterizzate da 512 CUDA Cores e un’interfaccia di memoria di tipo GDDR5 a 384 bit. Le frequenze operative per entrambe le GPU sono rispettivamente di 608/3414/1216 MHz. Ogni GPU ha 1536 MB di memoria di tipo GDDR5 per un totale di 3 GB. Il retro della scheda è parzialmente coperto da due placche metalliche che provvedono a dissipare il calore dalle memorie.

Rimuovendo la cover superiore è possibile vedere i due enormi dissipatori Vapor Chamber. Il corpo radiante è costituito da una base completamente in rame, mentre il radiatore in interamente alluminio. Il Vapor Chamber è saldamente ancorato al die della GPU grazie alla presenza di quattro viti che garantisce una presa ottimale. La Tecnologia Vapor Chamber permette grazie ad un corpo dissiparte esteso, di creare una vera e propria “camera di vapore”. L’evaporazione del liquido distribuisce il calore in maniera uniforme sull’intera superficie dissipante.

Le due gpu GF110, all’interno del PCB a 2 layer, sono dotate di 3 miliardi di transistor e sono prodotte da TSMC tramite processo produttivo a 40nm. Quasi al centro del PCB sono presenti il chip che gestisce la comunicazione delle due gpu, ovvero l’ NF200 e il due regolatori di tensione prodotti da CHiL che si occupano delle tensioni di alimentazioni delle gpu. Questi regolatori di tensione, sono configurabile tramite appositi software. Purtroppo Nvidia ha disabilitato la possibilità di variare la tensione delle GPU a causa dei primi incidenti sulle soluzioni GTX 590. Le fasi utilizzate per alimentare i due chip grafici sono dieci, ovvero cinque per ogni gpu.

La scheda supporta, inoltre, la tecnologia Multi-GPU SLI. Possiamo notare, infatti, il connettore necessari per il collegamento in parallelo di due schede grafiche identiche “Quad SLI”. Vi proponiamo l’animazione che mostra in tutta la sua bellezza la GeForce GTX 590:

Ed ecco il video di presentazione della Nvidia GTX 590:

{jospagebreak_scroll title=Point Of View GeForce GTX 590: Overclock}

Point Of View GeForce GTX 590: Overclock

Dopo le morti premature dei primi sample dovute al non corretto funzionamento del sistema di protezione della vga per via dei driver, Nvidia ha deciso di bloccare il voltaggio a 0,925v per evitare ulteriori problemi dalla release di ForceWare 270 in poi , quindi con gli attuali 275.33 è possibile spingere solamente la frequenza delle gpu senza toccare il voltaggio.

Per overcloccare la scheda abbiamo usato il tool prodotto da MSI, ovvero Afterburner. Il programma è molto completo e di facile utilizzo, infatti è possibile cambiare oltre alle frequenze del core delle Vram, anche il regime di ventola in base alla temperatura ed il voltaggio, ma in questo caso siccome è bloccato dai driver, tale opzione risulta inutile.

Dalle varie prove effettuate, la Point Of View GeForce GTX 590 riesce a reggere in piena stabilità i 670Mhz per il core (+10%), mentre le memorie sono state lasciate volutamente a default per evitare problemi di artefatti permanenti, il tutto lo ricordiamo con voltaggio stock. Il seguente risultato è stato raggiunto senza modificare la velocità di rotazione della ventola, in quanto le temperature rimangono pressoché invariate.

Come è possibile notare c’è un piccolo incremento nel Texture e Pixel FillRate, traducibile in un miglioramento delle performance.

Nel corso della recensione potrete osservare i risultati ottenuti in condizione di overclock.

N.B.: Ricordiamo che la pratica dell’overclock può danneggiare in modo permanente i componenti.

{jospagebreak_scroll title=Sistema di Prova e Metodologia di Test:}

Sistema di Prova e Metodologia di Test:

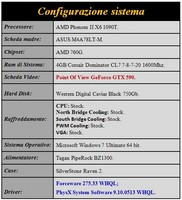

Per il sistema di prova ci siamo avvalsi di una scheda madre dotata di chipset AMD 760G, prodotta da ASUS, in particolare è stato scelto il modello M4A78LT-M.

Come processore è stato scelto un modello AMD appartenente alla famiglia Phenom II, precisamente X6 1090T. La frequenza di funzionamento è stata fissata a 3.800MHz, impostando il moltiplicatore a 19X e aumentando la frequenza del BCLK sino a 200MHz.

Per il comparto memorie la scelta è ricaduta su un kit prodotto da Corsair Dominator da 4GB di capacità assoluta. Sia la frequenza e sia le latenze sono state impostate ai valori di targa, vale a dire 1600MHz 7-8-7-20 a 1.65v.

Un riassunto della configurazione di prova la trovare nella tabella sottostante:

Tutti i test eseguiti sono stati ripetuti per ben tre volte, al fine di verificare la veridicità dei risultati. L’hardware è stato montato all’interno di un case SilverStone Raven 2 dotato di una buona areazione interna.

N.B: Il Case SilverStone Raven 2 utilizza un sistema particolare di dissipazione con i componenti interni girati di 90°. I risultati delle temperatuire possono pertanto variare rispetto ai tradizionali case.

Il sistema operativo, Microsoft Windows7 Ultimate X64 Service Pack1, è da intendersi privo di qualsiasi ottimizzazione particolare.

Queste le applicazioni interessate, suddivise in tre tipologie differenti:

Benchmark Sintetici – DX9/DX10:

- 3DMark05 – DX9.0c;

- 3DMark06 – DX9.0c;

- 3DMark Vantage – DX10.

Benchmark Sintetici – DX11:

- 3DMark 11 – DX11;

- Unigine Heaven Benchmark v2.1 – DX10/DX11;

- Stone Giant Benchmark – DX11.

Giochi – DX10:

- Resident Evil 5;

- Street Fighter IV;

- Crysis;

- FarCry2.

Giochi – DX11:

- S.T.A.L.K.E.R. Call of Pripyat;

- Lost Planet 2;

- Tom Clancy’s H.A.W.X. 2;

- Metro 2033.

Schede Grafiche in prova:

- Point Of View GeForce GTX 590 (608/1215/3414);

- Point Of View GeForce GTX 590 OC (670/1340/3414).

{jospagebreak_scroll title=Benchmark Sintetici – DX9/DX10:}

Benchmark Sintetici – DX9/DX10:

3DMark05:

Il 3DMark05 è un programma di stress test per schede video. Basato sulle API DirectX 9.0c. Questo test richiede la presenza di una scheda compatibile con le specifiche Pixel Shader 2.0 o superiori.

Il test è stato eseguito alla risoluzione nativa di 1024*768, con vari livelli di filtraggio AntiAliasing.

3DMark06:

l 3DMark06 è un programma di stress test principalmente per schede video, ma anche dell’intero PC. Infatti oltre a misurare le prestazioni del proprio computer con un punteggio finale, può essere utilizzato anche per controllare le temperature del sistema e per testare la stabilità in generale, anche a seguito di un overclock! La nuova versione deriva dal diretto predecessore e necessita di un hardware di ultima generazione per poter essere quanto più obiettivo possibile nel metro di giudizio (per esempio evitando frequenti swapping del disco durante le fasi di test ed andandone ad inficiare i risultati). La maggior parte dei test grafici sono stati ripresi dal 3DMark05 ed ulteriormente potenziati in quanto a gravosità di elaborazione e nuove funzionalità implementate. La principale differenza con la passata edizione sta nell’importanza conferita alla potenza di elaborazione del processore. Questo si basa sulla consapevolezza che la potenza delle GPU sta crescendo nel recente periodo con un passo più lungo di quello delle CPU, per cui con maggiore frequenza troviamo applicazioni CPU limited. Inoltre vi è da considerare quanto importante sta divenendo la CPU per l’elaborazione degli algoritmi della fisica dei corpi, della logica di gioco, dell’intelligenza artificiale, ecc.. Da qui la necessità di introdurre un doppio test specificatamente incentrato su questa tipologia di calcoli. Il punteggio del 3DMark06 è quindi il risultato della considerazione di GPU e CPU assieme e tende a valutare più come una piattaforma di calcolo sopporti un gioco futuro che a confrontare sottosistemi grafici tra loro. Altra differenza sta nella risoluzione usata come standard dal test (1280×1024 anziché 1024×768) e nella maggiore importanza conferita allo SM3.0, che secondo la casa sarà sempre più adoperato dai programmatori nei prossimi titoli ludici. Il 3DMark06 arriva con un doppio test centrato sullo SM2.0 e altrettanti test sullo SM3.0 e sull’HDR (High Dynamic Range). L’applicativo restituisce in output 3 sotto-punteggi: uno per lo SM2.0, uno per la CPU e l’ultimo per lo SM3.0.

Il test è stato eseguito alla risoluzione nativa di 1280*1024, con vari livelli di filtraggio AntiAliasing.

3DMark Vantage:

Il nuovo benchmark richiederà obbligatoriamente la presenza nel sistema sia di una scheda video con supporto alle API DirectX 10.

Il benchmark si compone di quattro distinti test, due incentrati sulla GPU e due sulla CPU. E’ possibile scegliere tra quattro preset configurati da Futuremark, caratterizzati da un livello di carico di lavoro differente così da meglio riprodurre lo scenario tipico di utilizzo del proprio sistema a seconda del tipo di configurazione Hardware in uso.

3DMark Vantage introduce per la prima volta il concetto di preset; mentre nelle versioni precedenti vi era una singola configurazione, il nuovo software consente di impostare la configurazione Entry, Performance, High e Extreme.

I test sono stati eseguiti, con e senza la tecnologia NVIDIA PhysX, sfruttando i seguenti preset: Entry, Performance e High.

{jospagebreak_scroll title=Benchmark Sintetici – DX11:}

Benchmark Sintetici – DX11:

3DMark 11:

Il nuovo benchmark richiederà obbligatoriamente la presenza nel sistema sia di una scheda video con supporto alle API DirectX 11. Secondo la software house Futuremark, i test sulla tessellation, l’illuminazione volumetrica e altri effetti usati nei giochi moderni rendono il benchmark moderno e indicativo sulle prestazioni “reali” delle schede video. La versione Basic Edition (gratuita) permette di fare tutti i test con l’impostazione “Performance Preset”. C’è un test, chiamato Audio Visual Demo, eseguibile alla risoluzione massima 720p. La versione Basic consente di pubblicare online un solo risultato. Non è possibile modificare la risoluzione e altri parametri del benchmark.

3DMark 11 Advanced Edition non ha invece alcun tipo di limitazione. Il primo test, basato sullo scenario Deep Sea, non applica la tessellation ma fa uso di un sistema d’illuminazione e ombre marcato.

Il secondo test, nuovamente fondato su Deep Sea, applica un livello di tessellation medio e riduce, anche in questo caso a livello intermedio, l’illuminazione. Il terzo test grafico, basato sullo scenario High Temple, ha un livello di tessellation medio e illuminazione ridotta. Il nuovo software consente di impostare la configurazione Entry, Performance e Extreme.Il benchmark non sfrutta la tecnologia PhysX di Nvidia.

I test sono stati eseguiti in DirectX 11 nelle tre modalità disponibili: Performance, High e Extreme.

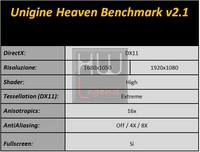

Unigine Heaven Benchmark v2.1:

Unigine ha presentato il suo benchmark DirectX 11, che permette agli utenti di provare la propria scheda video con le nuove librerie grafiche. Basato su motore Unigine, il benchmark Heaven v2.1 supporta schede video DirectX 11, DX 10, 9, OpenGL e il 3D Vision Surround di Nvidia.

I test sono stati condotti coni seguenti settaggi:

Nei grafici i risultati ottenuti, espressi sotto forma di FPS Medi e di Score finale.

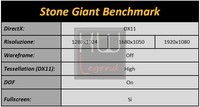

Stone Giant Benchmark:

Un nuovo test DirectX 11 si presenta al mondo. Stone Giant, realizzato da BitSquid con la collaborazione di FatShark, mira a mostrarci le novità della grafica basata sulle nuove librerie. I punti salienti di questo nuovo benchmark sono la profondità e gli effetti di campo Compute Shader 5, la Tessellation e il supporto Nvidia 3D Vision Surround. Grazie a scene con tessellation avanzata e livelli di geometria elevati, Stone Giant permette ai consumatori DX11 di provare le loro nuove schede grafiche. Crediamo che la grande fedeltà dell’immagine vista in Stone Giant, resa possibile con le funzionalità delle DX11, siano qualcosa che dobbiamo aspettarci dai giochi futuri, ha affermato Tobias Persson, fondatore e Senior Graphics Architect di BitSquid.

I test sono stati condotti con i seguenti settaggi:

{jospagebreak_scroll title=Giochi – DX10:}

Giochi – DX10:

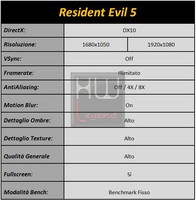

Resident Evil 5:

La storia è ambientata circa 10 anni dopo i famosi accadimenti di Racoon City del primo episodio. Chris Redfield non è più membro della S.T.A.R.S., ma di una nuova organizzazione chiamata BSAA, e i suoi scopi non sono del tutto chiari, tanto che il personaggio in un primo momento sembra ambiguo, non si riesce a capire se combatta per il “bene” o per il “male”. L’azione prende piede in un paesaggio africano, un villaggio sorto in mezzo al deserto, dove il nostro eroe Chris si troverà a indagare sui fatti misteriosi che vi sono accaduti. Appena arrivato, vi troverete ad avere a che fare con zombie dalla capacità intellettiva indubbiamente superiore rispetto agli altri mostri….. Il gioco supporta le DirectX 10.

I test sono stati condotti con il benchmark integrato usando i seguenti settaggi:

Street Fighter IV:

Il quarto capitolo firmato CAPCOM della saga più famosa della storia dei videogiochi ci permette di rivivere emozioni che credevamo di aver dimenticato per sempre. Con un motore grafico completamente riscritto, che ci lascerà a bocca aperta, ci ritroveremo a combattere con i nostri personaggi preferiti, a colpi di Ultra Combo, in ambientazioni straordinarie…il gioco sfrutta le DirectX 10.

I test sono stati condotti con il benchmark integrato usando i seguenti settaggi:

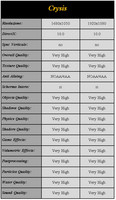

Crysis:

Sparatutto in prima persona rilasciato nel Novembre 2007 dalla casa di sviluppo tedesca Crytek, già nota per la sua prima creazione, Far Cry, rivelatosi uno dei migliori giochi per computer del 2004 grazie al suo innovativo e potente motore grafico CryEngine, ora arrivato alla seconda generazione (CryENGINE2). Il gioco è stato sia in modalità High, che in modalità VeryHigh. Il gioco supporta le DirectX 10.

I test sono stati condotti con i seguenti settaggi:

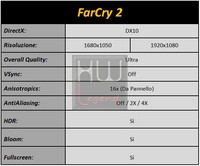

FarCry2:

FarCry è uno sparatutto in prima persona sviluppato da Crytek e pubblicato da Ubisoft. Il giocatore vestirà i panni dell’ex membro delle forze speciali dell’esercito statunitense Jack Carver. Far Cry è passato però alla storia soprattutto grazie al suo motore grafico, il CryENGINE sviluppato da CryTek. All’epoca della sua uscita, infatti, la grafica di Far Cry era quanto di meglio si fosse mai visto, capace di riprodurre la vegetazione e, soprattutto, l’acqua, con una qualità al limite del fotorealismo. Le isole su cui ogni livello era ambientato erano gigantesche, ed il giocatore godeva di una libertà quasi assoluta, potendole esplorare come preferiva. Anche i nemici erano, all’epoca, i più intelligenti mai visti in uno sparatutto: per la prima volta gli avversari controllati dal computer non partivano alla carica come dei pazzi suicidi, e per la prima volta si vedevano nemici che tentavano di aggirare il giocatore e prenderlo alle spalle, e spesso ci riuscivano…

I test sono stati condotti utilizzando il benchmark integrato con i seguenti settaggi:

{jospagebreak_scroll title=Giochi – DX11:}

Giochi – DX11:

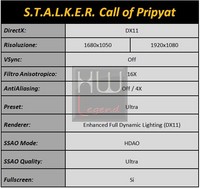

S.T.A.L.K.E.R. Call of Pripyat:

Sterminati due sfortunati mercanti incontrati poco dopo l’arrivo sul campo il nostro equipaggiamento compie un balzo di qualità istantaneo. E’ stato un incidente. Non ci crederà nessuno. Ma non è detto che qualcuno debba saperlo e chi vive nella Zona sa benissimo a cosa può andare incontro. Il primo luogo sicuro sulla nostra strada è la Skadovsk, una nave in secca dove trova riparo una comunità che può fornirci la maggior parte dei servizi fondamentali e, forse, qualche informazione.

Il Benchmark è composto di quattro test distinti. Abbiamo semplicemente calcolato la media dei risultati per determinare i frame medi. Questi i settaggi usati:

Lost Planet 2:

Lost Planet 2 è il seguito dello sparatutto in terza persona sviluppato e prodotto dalla Capcom. Basato sul motore grafico aggiornato MT-Framework 2.0 è ambientato 10 anni prima delle vicende di Lost Planet Extreme Condition. Teatro delle azioni sarà ancora una volta l’inquietante pianeta E.D.N. III, il cui glaciale paesaggio ha lasciato spazio ad intricate giungle con tanto di vegetazione e clima tropicale. La battaglia dei valorosi coloni contro i terribili Akrid continuerà a insanguinare le terre del travagliato corpo celeste.

I test sono stati condotti con il benchmark integrato usando i seguenti settaggi:

Tom Clancy’s H.A.W.X. 2:

Tom Clancy’s H.A.W.X. 2 si presenta come un simulatore di volo anche se non siamo esattamente di fronte a quello che può essere definito un simulatore, la componente spiccatamente arcade ha decisamente il sopravvento su quella prettamente realistica. Qualsiasi manovra vi venga in mente di fare con il vostro volatile d’acciaio, potrete farla, anche viaggiare per mezz’ora a testa in giù se necessario. Durante le nostre missioni, saremo normalmente chiamati a portare il nostro bestione ferroso in volo per poi ingaggiare in battaglia i nemici. In questo frangente avremo a disposizione mitragliatrice e i cari vecchi missili a ricerca, compagni di mille avventure. Per la difesa, invece, potremo avvalerci di una quantità ridotta di flare, capaci di fuorviare il sistema di ricerca dei missili nemici e, quindi, di farci evadere dalle situazioni più complicate. Volare, il sogno dell’uomo sin dall’alba dei tempi….si materializza in Tom Clancy’s H.A.W.X. 2.

I test sono stati condotti con il benchmark integrato usando i seguenti settaggi:

Metro 2033:

Mosca, anno 2033. In seguito ad una catastrofe nucleare, i sopravvissuti sono costretti a vivere nelle metropolitane della capitale russa, organizzati in stazioni simili a città stato. In quest’ultime si respira un’atmosfera opprimente e angosciante. Il buio cela molte insidie, tra le quali la frequente possibilità di imbattersi in mostruose creature che popolano le stazioni. La minaccia principale è rappresentata dai Tetri, definiti come i nuovi homines, “vincitori della battaglia per la sopravvivenza”, e destinati ad ereditare la Terra. Il personaggio interpretato dal giocatore è Artyom, cresciuto in una stazione della metropolitana situata sotto i quartieri più a nord di Mosca. All’arrivo di un misterioso amico del proprio patrigno, di nome Hunter, si viene incaricati segretamente di portare un messaggio di vitale importanza ad una grande stazione, chiamata Polis, spiegando la minaccia dei Tetri. Inizia così il viaggio del proprio personaggio, pieno di insidie, durante il quale incrontreremo le più mostruose creature derivate dalle radiazioni, banditi, criminali e rangers.

I test sono stati condotti con il benchmark integrato usando i seguenti settaggi:

{jospagebreak_scroll title=Considerazioni sulle prove:}

Considerazioni sulle prove:

Analizzando i risultati delle prove effettuate, la Point Of View GeForce GTX 590 rispecchia in pieno la filosofia intrapresa dalla ditta californiana con le sue Dual GPU, ovvero creare una scheda capace di gestire qualsiasi applicazione, che sia essa un videogioco o un benchmark, a qualsiasi risoluzione ed impostazione grafica.

La classica risoluzioni Full HD “1920×1080”, risulta praticamente sprecata per una scheda di questo calibro. A tale risoluzione la scheda non mostra alcun segno di cedimento anche usando filtri. Il vero campo di battaglia per la Point Of View GeForce GTX 590 è rappresentato dalle risoluzioni ben superiori, abbinate all’ uso della tecnologia 3D Vision Surround.

Altro aspetto importante riguarda la rumorosità e le temperature di esercizio. Durante tutte le prove, durate svariate ore, la ventola, mantenute con gestione automatica, risulta abbastanza silenzia. Il rumore prodotto in Idle ed in Full è paragonabile a quello della sorella minore GTX 580 a singola GPU.

Tirando le somme, possiamo assicurarvi che la soluzione Point Of View GeForce GTX 590 assieme alla rivale AMD HD6990, risulta essere attualmente la scheda video più veloce del mercato!

{jospagebreak_scroll title=Temperature, Rumorosità e Consumi:}

Temperature, Rumorosità e Consumi:

Temperature & Rumorosità:

NVIDIA dopo il problema della rumorosità e del calore prodotto con la GeForce GTX 480, si è impegnata molto sul campo del raffreddamento delle proprie vga, cercando di abbattere il rumore e abbassare le temperature di esercizio. Con la GeForce GTX 580 è stato introdotto il nuovo sistema di dissipazione a camera di vapore, introdotto svariati anni fa dalla Sapphire sulle sue schede overcloccate, che è riuscito a centrare gli obbiettivi prefissati. Con questa GeForce GTX 590, però Nvidia è riuscita in un vero “miracolo”, ossia utilizzando vari accorgimento come la ventola assiale invece di radiale e la tecnologia Vapor Chamber. Grazie a questi importanti e significativi aggiustamenti, Nvidia è riuscita a mantenere la rumorosità sia in Idle che in Full su ottimi livelli, risultando del tutto identica a quella della GeForce GTX 580.

Vi riportiamo di seguito le temperature medie in Idle e in Full-Load registrate durante le prove:

N.B: Il Case SilverStone Raven 2 utilizza un sistema particolare di dissipazione con i componenti interni girati di 90°. I risultati delle temperatuire possono pertanto variare rispetto ai tradizionali case.

Consumi:

La Point Of View GeForce GTX 590 vanta oltre a prestazioni da primato anche consumi da record. La nuova ammiraglia Nvidia ha un consumo massimo in grado di raggiungere i 350W di default ed oltre 450W in OC. Si rende necessario, quindi oltre che un ottimo alimentatore da almeno 700W, anche una scheda madre che disponga di uno slot PCI-E 16X in grado di erogare sino a 150W. Consideriamo la potenza messa a disposizione dalla scheda veramente impressionante, già alle impostazioni standard. Riteniamo quindi superfluo l’utilizzo dell’ overclock, se non per prove veloci in benchmark.

Di seguito vi mostriamo i consumi del sistema di prova completo, misurati direttamente alla presa di corrente. Le misurazioni sono state ripetute più volte, nel grafico la media delle letture nelle seguenti condizioni:

- Idle;

- Full-Load Gaming “10 Loop di Crysis”;

- Full-Load Stress “3 Loop di 3DMark Vantage”.

{jospagebreak_scroll title=Conclusioni:}

Conclusioni:

| Prestazioni/Overclock: | |

| Rapporto Qualità/Prezzo: | |

| Rumorosità/Consumi: | |

| Giudizio Complessivo: |

La Point Of View GTX 590 è una scheda grafica dalla potenza esorbitante, destinata all’uso di quegli utenti disposti ad avere il massimo delle prestazioni, senza badare ai consumi e al costo. Insieme alla rivale HD6990, si colloca al gradino più alto del mercato, offrendo prestazioni da primato e features proprietarie di tutto rispetto, come CUDA, Physx e supporto al 3D Vision Surround.

Prestazioni elevate = Consumi Elevati. D’altronde non poteva essere altrimenti, dopo tutto stiamo pur sempre parlando di una scheda basata su ben due GF110, posti sullo stesso PCB. Consigliamo a tutti gli interessati a questo prodotto di munirsi di un alimentatore di buona qualità, dotato di due connettori di tipo PCI-E a 8pin, oltre che di una scheda madre dotata di slot PCI-E 16X, in modo da gestire correttamente le richieste energetiche della GeForce GTX 590.

Punto forte della soluzione Point Of View GTX 590 che ci ha colpito è rappresentato dal sistema di raffreddamento. Grazie a tanti piccoli accorgimenti, come l’uso della tecnologia Vapor Chamber, permette di gestire tranquillamente le temperature della vga sia a default sia in overclock. Il dissipatore risulta estremamente silenzioso, garantendo un confort acustico di ottimo livello. Ricordiamo che questo nuovo sistema, per dare il meglio di se, necessita di un case dotato di buona aerazione interna, in quanto parte dell’aria, spinta dalla ventola, viene rigettata all’interno del case stesso.

La Point Of View GTX 590 è disponibile sul mercato a un prezzo medio di circa 630€ IVA compresa, cifra senz’altro elevata, ma ampiamente giustificata dalle caratteristiche uniche e dalle prestazioni in grado di offrire. In definitiva, raccomandiamo l’acquisto della GTX 590 della Point Of View a tutti gli utenti che vogliono le massime prestazioni senza alcuna limitazione.

Pro:

- Doppia GPU GF110, con 1024 Cuda Core, in SLi;

- 1,5GB di memoria GDDR5 a disposizione di ogni GPU;

- Prestazioni elevatissime in ogni frangente;

- Ottimo sistema di dissipazione reference;

- Ottime feature supportate (Cuda, Physx, 3D Surround etc.);

- Supporto Multi-GPU Quad SLi.

Contro:

- Consumi abbastanza elevati;

- Overclock limitato dai driver.

Si ringrazia Point Of View per il sample fornitoci.

Seguite il Thread Ufficiale sul nostro forum.

Lorenzo De Sanctis – “LurenZ87” – Staff di HW Legend

![Kingston FURY Renegade G5 NVMe M.2 SSD 2TB [SFYR2S/2T0] Cop - Kingston FURY Renegade G5 NVMe M.2 SSD 2TB [SFYR2S2T0]](https://www.hwlegend.tech/wp-content/uploads/2025/10/Cop-Kingston-FURY-Renegade-G5-NVMe-M.2-SSD-2TB-SFYR2S2T0-150x150.webp)